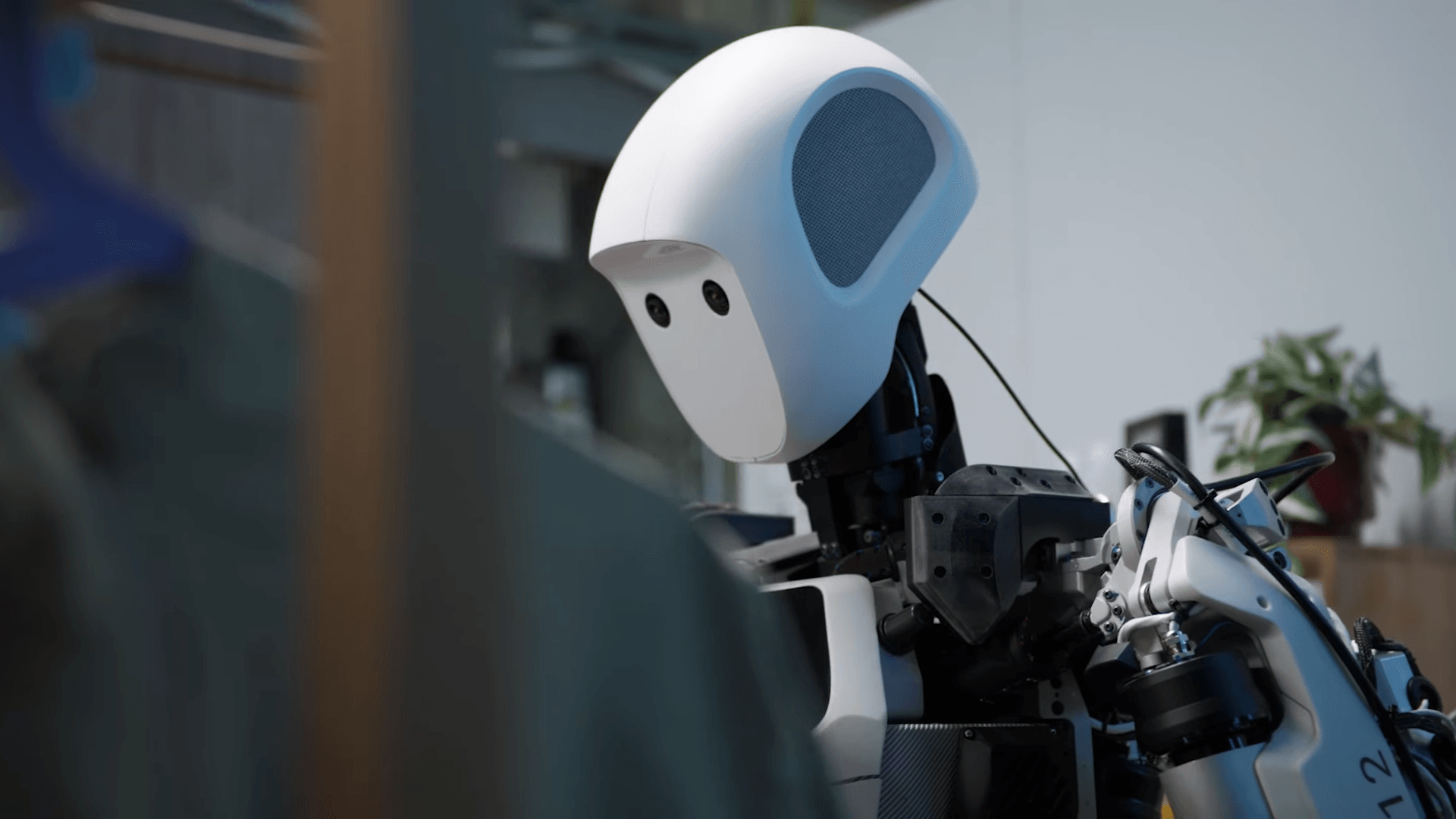

Das Münchner Unternehmen Agile Robots und Google Deepmind haben eine strategische Forschungspartnerschaft geschlossen. Ziel ist es, die Gemini-Robotics-KI-Modelle von Google Deepmind in die Robotik-Hardware von Agile Robots zu integrieren. So sollen anpassungsfähige, intelligente Roboter primär für industrielle Umgebungen entstehen, in denen ein "akuter und wachsender Bedarf an anpassungsfähiger, verlässlicher Automatisierung besteht".

Carolina Parada, Leiterin der Robotik-Abteilung bei Google Deepmind, bezeichnete die Zusammenarbeit als "wichtigen Schritt, um die Wirkung von KI in die reale Welt zu übertragen". Daten aus dem realen Betrieb sollen die KI-Modelle laufend verbessern, die wiederum die Fähigkeiten der Roboter erweitern.

Das 2018 in München gegründete Unternehmen Agile Robots beschäftigt mehr als 2.500 Mitarbeitende und hat nach eigenen Angaben weltweit bereits über 20.000 Robotiklösungen installiert. Google Deepmind hatte zuletzt mit Gemini Robotics 1.5 und Gemini Robotics-ER 1.5 zwei neue KI-Modelle vorgestellt, die Roboter dazu befähigen sollen, komplexe Aufgaben in der physischen Welt eigenständig zu planen, zu verstehen und auszuführen.